Gdzie naprawdę przebiega granica: od sterownika, przez edge, do chmury

Sterownik PLC – serce deterministycznej automatyki

W klasycznej automatyce przemysłowej wszystko zaczyna się od sterownika PLC. To on odpowiada za deterministyczne sterowanie: zbiera sygnały z czujników, przetwarza logikę i wysyła komendy do napędów, zaworów czy robotów. Cykle pracy liczone są w milisekundach, a cała konstrukcja jest podporządkowana temu, by sterownik reagował zawsze tak samo, z przewidywalnym czasem odpowiedzi.

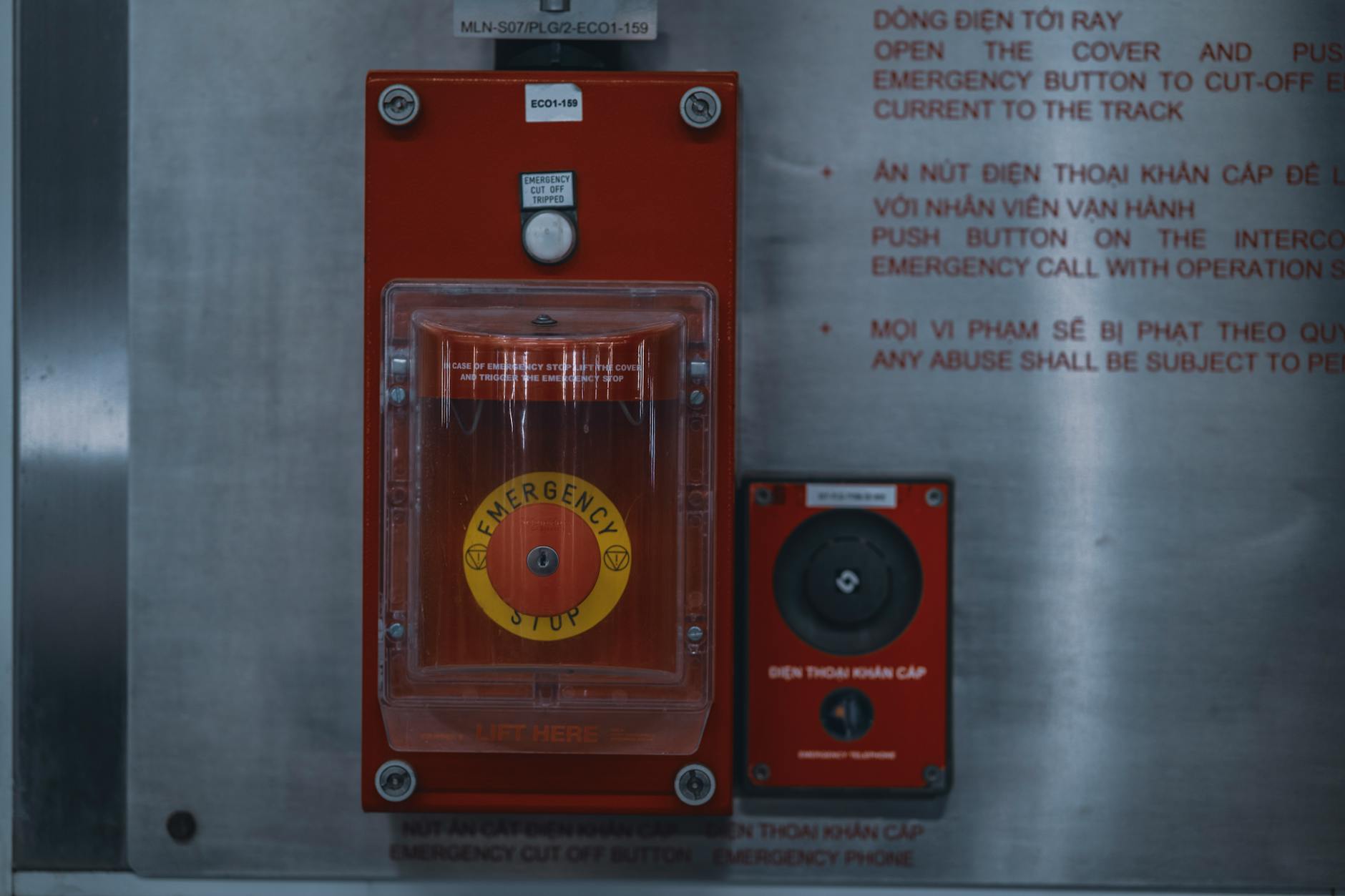

Dla wielu osób to jest właśnie „maszyna” – szafa sterownicza z PLC i modułami wejść/wyjść. W tej warstwie nie ma miejsca na eksperymenty z niestabilnym oprogramowaniem, długimi aktualizacjami czy dużymi opóźnieniami sieci. Jeżeli trzeba wyłączyć prasę, bo wykryto obecność człowieka w strefie niebezpiecznej, decyzja musi zapaść lokalnie, w ułamku sekundy. Tu nie ma chmury, tu jest twarda automatyka.

Prosta reguła brzmi: wszystko, co decyduje bezpośrednio o bezpieczeństwie i ciągłości procesu, musi zostać w PLC lub w innej lokalnej warstwie sterowania czasu rzeczywistego. Próba przeniesienia takich decyzji do chmury lub zbyt „miękkiej” warstwy edge kończy się zwykle co najmniej dużą frustracją, a w skrajnych przypadkach – poważnym incydentem.

Warstwa edge – pomost między maszyną a światem IT

Powyżej sterownika pojawia się edge computing: komputery, kontrolery edge, gatewaye, które zbierają dane z wielu PLC, czujników i systemów, a następnie wstępnie je przetwarzają. Edge nie zastępuje sterownika – raczej go „uzupełnia”, nadając danym kontekst, normalizując protokoły i przygotowując informacje do przesłania dalej.

Warstwa edge najczęściej realizuje zadania, które są już nad sterowaniem, ale wciąż wymagają lokalności: niskich opóźnień, działania offline, a czasem też specyficznej integracji z urządzeniami. Tu pojawiają się takie funkcje jak:

- agregacja danych z wielu źródeł (różne PLC, czujniki IoT, wagi, czytniki kodów),

- ujednolicanie protokołów i mapowanie tagów na standardowe modele danych,

- wstępna analityka i obliczanie lokalnych wskaźników (OEE, alarmy, trendy),

- buforowanie danych na wypadek braku łączności z chmurą,

- lokalne decyzje wspierające produkcję, ale niekrytyczne dla bezpieczeństwa.

Edge działa jak „tłumacz i organizator ruchu” między światem automatyki (OT) a światem IT. Dzięki temu chmura nie musi znać każdego protokołu polowego ani każdej osobliwej cechy starego PLC.

Chmura – globalny mózg, ale z dystansem do maszyny

Warstwa chmury w automatyce przemysłowej to głównie analityka, archiwizacja i integracja biznesowa. Systemy chmurowe świetnie radzą sobie z dużymi zbiorami danych historycznych, zaawansowanymi modelami uczenia maszynowego, zasilaniem wielu zakładów jednocześnie czy udostępnianiem informacji poza organizację (np. serwis producenta maszyny).

Chmura nie jest jednak dobrą kandydatką do bezpośredniego sterowania maszyną. Powody są proste:

- opóźnienia sieci – nieprzewidywalne, zależne od łącz i routingu,

- brak gwarantowanej deterministyczności reakcji,

- ryzyko utraty łączności – awaria sieci nie może zatrzymać całego procesu sterowania.

Dlatego rozsądna granica wygląda zwykle tak: chmura decyduje o strategii, edge i PLC decydują o taktyce. W chmurze można policzyć optymalne parametry produkcji na podstawie tygodni danych, a potem wynik w postaci kilku nastaw przekazać do edge, który zadba o bezpieczne wdrożenie tych nastaw w PLC.

Granica funkcjonalna – co MUSI być na dole, a co może być w górze

Jeżeli spojrzeć na architekturę nie od strony urządzeń, ale od strony funkcji, granica zaczyna być jeszcze wyraźniejsza. Funkcje typowo „przy maszynie” to:

- logika sterowania sekwencjami (start/stop, przejścia między stanami),

- regulacja PID, synchronizacja osi, bezpieczeństwo funkcjonalne,

- interlocki, blokady, warunki awaryjnego zatrzymania,

- lokalne HMI potrzebne do utrzymania ruchu i obsługi.

Natomiast funkcje, które można przenieść wyżej (edge lub chmura), to m.in.:

- raporty produkcyjne i analizy wydajności,

- agregacja danych z wielu linii i hal,

- modele predykcyjnego utrzymania ruchu,

- systemy planowania produkcji i harmonogramowania,

- zaawansowane analizy jakości (np. analiza obrazów z kamer z wykorzystaniem AI).

Im większa wrażliwość funkcji na czas reakcji oraz im bliżej jest ona bezpieczeństwa, tym głębiej powinna być umieszczona – w sterowniku lub bardzo blisko niego. Im bardziej funkcja ma charakter analityczny, raportowy lub planistyczny, tym wyżej można ją przesunąć – aż do chmury.

Granica organizacyjna: OT vs IT i rzeczywiste kompetencje

Granica między edge a chmurą przebiega także po linii organizacyjnej. Warstwa sterowania i edge jest zwykle zarządzana przez dział UT/OT (utrzymanie ruchu, automatyka), a chmura – przez IT, centralne struktury korporacyjne lub dostawcę zewnętrznego. To ma ogromny wpływ na projekt.

Jeżeli dane „znikają” od razu w chmurze, dział automatyki traci nad nimi kontrolę. W przypadku awarii łącza czy opóźnień w aktualizacjach, zespół UR często nie ma narzędzi, by szybko zdiagnozować problem. Gdy część logiki wspierającej produkcję (np. zaawansowane receptury, zmiany nastaw) zostanie umieszczona w systemie mocno kontrolowanym przez IT, pojawiają się też konflikty priorytetów: IT patrzy na bezpieczeństwo i standaryzację, OT – na dostępność i czas reakcji.

Umieszczając więcej funkcji na warstwie edge, można zrównoważyć te interesy. Edge jest jeszcze „blisko produkcji”, ale może być zarządzany z wykorzystaniem narzędzi IT (np. aktualizacje oprogramowania, kopie zapasowe), bez konieczności dotykania krytycznego sterowania PLC.

Granica fizyczna: gdzie faktycznie stoją urządzenia edge

W wielu zakładach edge computing „materializuje się” w postaci konkretnych urządzeń: komputerów przemysłowych, gatewayów IoT lub kontrolerów edge, montowanych w szafach sterowniczych, na poziomie linii, hali lub całego zakładu. Decyzja, gdzie je ustawić, wpływa na niezawodność, bezpieczeństwo i koszty.

Najczęściej stosowane są trzy podejścia:

- Edge przy maszynie – mały kontroler lub IPC w tej samej szafie, co PLC; minimalne opóźnienia i brak zależności od sieci zakładowej, ale więcej urządzeń do utrzymania.

- Edge na poziomie linii/hali – centralny serwer edge zbierający dane z wielu sterowników; dobra skalowalność, łatwiejsze zarządzanie, ale zależność od sieci na hali.

- Edge w DMZ – serwery w strefie pośredniej między siecią produkcyjną a biurową/Internetem; większy nacisk na bezpieczeństwo i segmentację, lecz mniejsza „bliskość” do maszyny.

Segmentacja sieci (np. VLAN-y, strefy OT, DMZ, firewalle) często podpowiada, gdzie granica edge–chmura jest najbardziej naturalna. Urządzenia edge stają się wtedy swoistymi strażnikami bramy: przejmują ruch z hali produkcyjnej, filtrują go, anonimizują dane tam, gdzie to konieczne, i dopiero wtedy puszczają dalej.

Krótkie przypomnienie podstaw: od klasycznej automatyki do Przemysłu 4.0

Piramida automatyki a „spłaszczone” architektury

Przez lata królował model piramidy automatyki: na dole urządzenia polowe (czujniki, napędy), wyżej sterowniki PLC, nad nimi SCADA/HMI, następnie systemy MES, a na szczycie ERP. Przepływ danych i decyzji był stosunkowo prosty, hierarchiczny – mało kto myślał o przesyłaniu surowych danych z czujnika aż do systemu biznesowego.

Przemysł 4.0 wprowadził jednak inne oczekiwania. Dane z czujników i PLC stały się cennym „paliwem” dla analityki, modeli predykcyjnych, optymalizacji planowania czy dynamicznego zarządzania energią. Pojawiło się dążenie do spłaszczania architektury – zamiast piramidy, bardziej sieć połączonych usług i systemów.

W praktyce oznacza to, że czujnik może równocześnie:

- podawać informację do PLC (sterowanie),

- być odczytywany przez edge w celu analizy trendów,

- dostarczać dane do systemu MES i chmury z pominięciem części warstw pośrednich.

Edge computing pomaga utrzymać porządek w tym złożeniu: zamiast dziesiątek bezpośrednich połączeń „czujnik–chmura”, mamy jeden lub kilka punktów konsolidacji danych.

Nowe oczekiwania wobec danych z maszyn

Cyfryzacja sprawiła, że dane z maszyn są oczekiwane częściej, szerzej i w innym kontekście niż kiedyś. Kilka lat temu wystarczał dzienny raport produkcyjny. Dziś standardem staje się:

- monitorowanie OEE i wskaźników jakości w czasie zbliżonym do rzeczywistego,

- dostęp do danych z linii z poziomu działu planowania, jakości, logistyki, a czasem nawet klientów,

- łączenie danych procesowych z danymi biznesowymi (zamówienia, partie materiałowe, koszty energii).

Edge computing w przemyśle pełni tu rolę „lokalnego dyspozytora danych”: zbiera sygnały z czujników, łączy je z kontekstem (np. numer zlecenia, zmiana pracownicza), a następnie wystawia w ujednoliconym formacie dla wyższych warstw. Dzięki temu nie trzeba do każdego PLC dokładać osobnego „tunelu” do chmury czy systemu MES.

Czego potrzebuje współczesna produkcja

Współczesna produkcja oczekuje od systemów automatyki i IT kilku kluczowych zdolności:

- przewidywania awarii – zamiast reagowania na zatrzymaną maszynę, lepiej dostać ostrzeżenie dzień wcześniej, że łożysko zaczyna się zużywać,

- szybkich przezbrojeń i elastyczności – krótkie serie, częste zmiany asortymentu wymagają szybkiej zmiany receptur, programów robotów, nastaw,

- wizualizacji „na żywo” – brygadziści, liderzy linii chcą widzieć sytuację tu i teraz, bez czekania na raport po zmianie,

- łatwiejszej integracji nowych urządzeń – każdy nowy robot czy waga nie może oznaczać miesięcy pracy IT.

Edge computing odpowiada na te potrzeby, umożliwiając rozbudowę funkcjonalności bez konieczności głębokiej ingerencji w istniejące PLC i SCADA. Część „inteligencji” można dobudować obok istniejących systemów, stopniowo i z kontrolą ryzyka.

Dlaczego sama chmura nie załatwia sprawy

Pojawienie się łatwo dostępnych platform chmurowych skusiło wiele firm do prostego pomysłu: „wyślijmy wszystko do chmury, tam się policzy”. Rzeczywistość szybko ostudziła entuzjazm. Problemy są powtarzalne:

- opóźnienia – analiza w chmurze jest świetna do trendów i predykcji, ale do reakcji w sekundach już mniej,

- koszty transferu danych – wysyłanie surowych, wysokoczęstotliwościowych danych (np. wibracje z czujników) bez filtracji to prosty sposób na zaskakujące faktury,

- bezpieczeństwo i regulacje – nie wszystkie dane mogą legalnie i bezpiecznie trafić do chmury w postaci surowej (np. dane mogące ujawnić tajemnicę produkcyjną),

- trudności integracyjne – bez warstwy pośredniej coraz więcej systemów „dotyka” PLC, co zwiększa złożoność i ryzyko błędów.

Edge computing rozwiązuje sporą część z tych bolączek: zamiast wysyłać wszystko, wysyła się dane już przetworzone, zagregowane lub zredukowane do wskaźników i zdarzeń. Chmura otrzymuje informacje, których naprawdę potrzebuje, a nie zalew sygnałów.

Czym jest edge computing w automatyce – definicje bez marketingu

Prosta definicja edge w świecie automatyki

Edge computing w automatyce to sprzęt i oprogramowanie przetwarzające dane możliwie blisko źródła ich powstawania – czyli przy maszynie, linii produkcyjnej lub w obrębie zakładu. Celem jest wykonanie tej części pracy, która:

- wymaga niskich opóźnień,

- musi działać nawet przy przerwanych łączach,

- dotyczy danych bardzo szczegółowych i „gęstych”,

- jest wrażliwa ze względu na bezpieczeństwo lub tajemnicę procesu.

Nie chodzi przy tym o modele sztucznej inteligencji czy skomplikowane mikroserwisy na starcie. W wielu zakładach edge zaczyna się od prostych zadań: lokalnej agregacji danych z kilku PLC, obliczania wskaźników w 1–5‑sekundowych interwałach, buforowania historii, a dopiero później odpalane są na nim bardziej złożone analizy. To coś jak „rozszerzony rejestrator” i „lokalny analityk” w jednym urządzeniu.

Czego edge NIE zastępuje w klasycznej automatyce

Edge computing w automatyce nie jest następcą PLC. Sterowniki nadal odpowiadają za deterministyczne sterowanie maszyną, bezpieczeństwo funkcjonalne, logikę sekwencyjną. Edge nie powinien przejmować funkcji typu E‑STOP, blokad bezpieczeństwa, podstawowych interlocków procesowych. Lepiej traktować go jako dodatkową warstwę usług nad istniejącą automatyką, a nie nowy „mózg maszyny”.

Nie jest to też cudowny sposób na ominięcie dobrych praktyk projektowych. Jeśli sygnały w polu są źle opisane, topologia sieci nieuporządkowana, a standard adresacji w PLC nie istnieje, urządzenie edge tylko to uwidoczni. W kilku fabrykach dopiero wdrożenie edge „zmusza” zespoły do uporządkowania opisów tagów czy segmentacji sieci – i to jest dodatkowa, często niedoceniana korzyść.

Typowe zadania edge w zakładzie – bez marketingowego lukru

W codziennej pracy produkcji i utrzymania ruchu edge najczęściej realizuje kilka prostych, ale bardzo użytecznych ról. Łączy dane z wielu sterowników, normalizuje je (nazwy, jednostki, skale), dodaje kontekst produkcyjny (zlecenia, partie, zmiany), przechowuje lokalną historię i wystawia te informacje dalej – do systemów MES, raportowania, chmury. Dla operatora ważne jest to, że ekran OEE ma sensowne liczby, a nie to, czy liczy je PLC, czy serwer w szafie obok.

Druga kategoria zadań to lokalne algorytmy wsparcia decyzji: proste modele predykcyjne oparte na wibracjach czy temperaturach, detekcja anomalii, szybkie reguły „jeśli–to” działające poza kodem PLC. W jednej z fabryk spożywczych wprowadzenie edge ograniczyło liczbę fałszywych alarmów z detektorów metali – urządzenie przy linii uczyło się typowych wzorców pracy, a do sterownika wracał już tylko „przefiltrowany” sygnał alarmowy.

W dobrze poukładanej architekturze edge‑to‑cloud ta dodatkowa warstwa przestaje być modnym dodatkiem, a staje się normalnym elementem krajobrazu automatyki – obok szaf sterowniczych, sieci przemysłowej i systemów nadrzędnych. Granica między maszyną a chmurą przesuwa się wtedy z poziomu „magicznego kabla do Internetu” na jasno zdefiniowane węzły edge, nad którymi można zapanować zarówno od strony technicznej, jak i organizacyjnej.

Jak zdecydować, co zostaje przy maszynie, a co w chmurze

Proste pytania, które porządkują architekturę

Zamiast zaczynać od listy funkcji platformy czy katalogu sprzętu, lepiej zadać kilka bardzo przyziemnych pytań o każdy typ danych i każdą funkcję:

- Jak szybko trzeba zareagować? Sekundy i poniżej – to raczej sterownik lub edge. Minuty i godziny – edge lub chmura. Dni – w większości przypadków sama chmura wystarczy.

- Co się stanie, jeśli łącze do chmury padnie? Jeśli proces ma dalej działać w pełni – krytyczna logika nie może wisieć w chmurze. W razie braku łączności chmura powinna być „niewidoczna” dla operatora.

- Jak „gęste” i poufne są dane? Wysoka częstotliwość (wibracje, przebiegi prądów, szybkie pozycje osi) oraz dane odsłaniające tajemnice procesu zwykle najpierw obrabia się lokalnie, a do chmury wypycha wnioski.

- Kto faktycznie korzysta z tych informacji? Utrzymanie ruchu i operatorzy – często edge. Planowanie, zarząd, łańcuch dostaw – zwykle chmura lub systemy zakładowe.

Te kilka pytań porządkuje dyskusję. Zamiast ogólnego „chcemy IoT”, można powiedzieć: „sygnał temperatury łożyska z czujnika idzie do PLC (sterowanie), do edge (predykcja), a w chmurze potrzebujemy tylko wskaźnika stanu i historii alarmów”.

Macierz podziału zadań: PLC – edge – chmura

Dobrym ćwiczeniem jest rozrysowanie prostej tabeli, gdzie w wierszach znajdują się funkcje (np. sterowanie PID, OEE, raporty dzienne, predykcja awarii), a w kolumnach: PLC, edge, chmura. Następnie każdą funkcję trzeba „przykleić” do jednej warstwy głównej i ewentualnie warstwy pomocniczej.

Przykładowy, uproszczony podział wygląda często tak:

- PLC – pętle regulacji, sekwencje start/stop, bezpieczeństwo, twarde interlocki, podstawowe liczniki sztuk i czasów.

- Edge – kalkulacja OEE w krótkich interwałach, korelacje między sygnałami, szybka analiza trendów, buforowanie danych do wysłania, wstępne modele predykcyjne.

- Chmura – długoterminowe raporty, porównania między zakładami, trenowanie i aktualizacja modeli ML, dashboardy zarządcze, integracja z systemami biznesowymi.

Kiedy zespół automatyki i IT wspólnie uzupełni taką macierz, znikają nieporozumienia typu: „dlaczego wszystko jest w chmurze?” lub „czemu ten raport liczy PLC, skoro nie ma tam miejsca na historię?”.

Decydowanie „od końca”: zacznij od użytkownika

Jest jeszcze jedna, bardzo praktyczna perspektywa: zamiast myśleć od strony sygnałów, można myśleć od strony użytkownika informacji. Najpierw: kto i po co ma oglądać dany wykres, alarm czy raport? Dopiero potem: co musi zostać przy maszynie, co w zakładzie, a co w chmurze.

Przykład z życia: kierownik utrzymania ruchu chciał mieć powiadomienia o rosnących wibracjach łożysk na maila, a operator – prosty „semafor” na HMI. Ostatecznie:

- surowe dane z akcelerometrów zostały przy maszynie i w edge,

- model progowy liczył się na urządzeniu edge,

- do chmury trafiały tylko zdarzenia i kilka parametrów trendu, z których generowane były maile.

Operator dostał lampkę na ekranie w kilka sekund, a kierownik – przetrawione informacje na mailu. Ta sama „historia danych”, ale inne miejsca przetwarzania i inne formaty.

Typowe funkcje edge w zakładzie produkcyjnym – z praktycznymi przykładami

Lokalna agregacja i normalizacja danych

Pierwszym, najczęściej wdrażanym zadaniem edge jest rola lokalnej „pompy danych”. W jednym urządzeniu zbierane są informacje z wielu sterowników, czujników i urządzeń pomocniczych. Realnie sprowadza się to do kilku pracowitych kroków:

- podłączenie się do PLC różnych producentów i „wyciągnięcie” z nich odpowiednich tagów,

- konwersja protokołów (Modbus, OPC UA, własne API, czasem stare RS‑y) do jednego formatu,

- nadanie czytelnych nazw, jednostek, dopisanie podstawowego kontekstu (linia, maszyna, stanowisko).

W jednej z firm produkcyjnych edge posłużył po prostu jako „tłumacz” między starą linią a nowym systemem MES: nic nie liczył, tylko agregował i udostępniał dane w ujednolicony sposób. Dla zespołu IT to była ogromna ulga – z jednego źródła pobierał dane zamiast łączyć się z pięcioma różnymi sterownikami.

Buforowanie i lokalna historia

Druga typowa funkcja to lokalny bufor danych. Chmura może na chwilę zniknąć, sieć WAN może spowolnić, ale proces produkcyjny nadal pracuje, a dane „lecą”. Edge potrafi zebrać historię minut, godzin, a czasem nawet dni – zależnie od konfiguracji i ilości sygnałów – a następnie „dogonić” chmurę, gdy łączność wróci.

Dodatkowo taki lokalny historian przydaje się utrzymaniu ruchu: inżynier nie musi za każdym razem logować się do systemu chmurowego, żeby sprawdzić, co działo się z maszyną w nocy. Wchodzi na lokalny dashboard, filtruje ostatnie kilka godzin i już widzi, jak zachowywały się kluczowe sygnały przed awarią.

Szybkie liczenie wskaźników produkcyjnych

Edge świetnie nadaje się do liczenia wskaźników, które muszą być dostępne tu i teraz, ale nie muszą być liczonych w czasie rzeczywistym co milisekundę. Klasyczne przykłady:

- OEE i jego składowe na poziomie maszyny lub linii,

- czasy cykli, przestoje według przyczyn,

- jakość partii produkcyjnej (np. odsetek odrzuconych sztuk).

Sterownik PLC nie musi znać definicji wszystkich rodzajów przestojów i liczyć ich czasu, a SCADA nie musi być przerabiana przy każdym nowym raporcie. Logika liczenia wskaźników może być zaimplementowana w edge, blisko danych, a następnie wyniki – w formie prostych tagów lub serwisu API – udostępniane SCADA, MES czy chmurze.

Wstępne przetwarzanie „ciężkich” danych sensorycznych

Dane wibracyjne, przebiegi prądów, obrazy z kamer, szybkie sygnały analogowe – to wszystko bardzo szybko generuje duże wolumeny informacji. Wysyłanie tego w surowej postaci do chmury jest kosztowne, a często i niepotrzebne. Edge może pełnić rolę lokalnego „filtra” i ekstraktora cech:

- oblicza proste statystyki (min, max, RMS, częstotliwości dominujące),

- wykrywa nagłe skoki lub odchylenia od typowych wzorców,

- decyduje, kiedy zrzucić surowy fragment danych (np. 10 sekund przed i po zdarzeniu).

Dzięki temu do chmury trafiają tylko dane z „ciekawych momentów” oraz skondensowane cechy. Modele predykcyjne nadal mają z czego się uczyć, a łącze i budżet na transfer nie są przeciążone.

Lokalne algorytmy wspierające decyzje operatora

Nie wszystkie decyzje da się (lub powinno się) automatyzować do końca. Czasem lepszym podejściem jest podpowiedź dla operatora. Edge może analizować korelacje sygnałów i na tej podstawie wyświetlać na HMI proste komunikaty:

- „Zwiększone drgania na osi X podczas szybkich ruchów – sprawdź prowadnicę”

- „Spadek wydajności przy obecnych parametrach – rozważ zmianę prędkości podajnika”

To nadal nie jest „magiczna AI”, tylko dobrze przygotowane reguły i proste modele oparte na danych z lokalnej historii. Różnica w stosunku do klasycznych systemów polega głównie na tym, że nowe reguły można wdrażać i testować bez modyfikacji kodu w PLC, korzystając z elastyczności środowiska edge.

Most między światem OT a IT

Edge często bywa także bramą bezpieczeństwa między siecią produkcyjną a siecią biurową lub internetem. Zamiast wpuszczać ruch z chmury bezpośrednio do sterowników, buduje się izolowaną strefę, w której działa urządzenie edge. Tam kończą się połączenia z chmury, tam też odbywa się większość operacji integracyjnych.

To właśnie ten punkt staje się naturalnym miejscem na:

- autoryzację użytkowników i systemów zewnętrznych,

- filtrowanie i inspekcję ruchu sieciowego,

- wymuszanie polityk bezpieczeństwa (np. kto może wysłać polecenie receptury do linii).

Dla służb cyberbezpieczeństwa to wygodny „zawór odcinający” – łatwiej kontrolować jeden dobrze opisany węzeł w strefie pośredniej niż dziesiątki bezpośrednich połączeń do PLC.

Architektura edge-to-cloud krok po kroku – jak to poukładać

Krok 1: Inwentaryzacja danych i połączeń

Zanim jakiekolwiek urządzenie trafi do szafy, przydaje się szczera lista: skąd bierzemy dane, jakie protokoły są używane, kto dziś się z czym łączy. Nazwanie tego po imieniu często ujawnia „schowane” integracje: dawny projekt, który nadal odczytuje coś z PLC, stary serwer raportów, laptop na linii podłączony „na stałe”.

Dobrą praktyką jest stworzenie prostej mapy:

- maszyny i ich sterowniki,

- aktualne systemy nadrzędne (SCADA, MES, LIMS, ERP),

- aktualne przepływy danych do/ze świata zewnętrznego (VPN, dostęp zdalny, integracje z chmurą).

Na tej mapie widać potem, gdzie naturalnie umieścić węzły edge: przy liniach, przy gniazdach produkcyjnych, a może centralnie w serwerowni zakładowej.

Krok 2: Wybranie „miejsc kotwiczenia” edge

Edge może być bardzo lokalny (mały komputer w szafie przy maszynie) albo bardziej centralny (serwer w szafie IT obsługujący całą halę). Dobór zależy od kilku czynników:

- odległości i jakości sieci – przy słabej infrastrukturze lepiej mieć kilka mniejszych węzłów bliżej maszyn,

- wymagań czasowych – im krótsze czasy reakcji, tym bliżej źródła danych warto przetwarzać,

- organizacji utrzymania – czy ktoś na miejscu potrafi obsłużyć kilka rozproszonych urządzeń, czy wygodniej serwisować centralny serwer.

Często sprawdza się podejście mieszane: niewielkie edge’y przy kluczowych liniach (np. wypełniacze, pakowanie), a do tego jeden węzeł zakładowy zbierający dane zbiorczo i komunikujący się z chmurą.

Krok 3: Zdefiniowanie kontraktu danych między warstwami

Między maszyną, edge a chmurą warto jasno ustalić, jakie dane i w jakiej formie płyną. Chodzi o swoisty „kontrakt danych”, który mówi:

- jakie sygnały surowe czyta edge z PLC (np. listy tagów, częstotliwość odczytu),

- jakie wskaźniki i zdarzenia edge wystawia dla MES/SCADA (np. OEE, stany pracy, kody przestojów),

- jaką paczkę danych edge wysyła do chmury (np. co 10 sekund pakiet agregatów i co 5 minut snapshot ważniejszych sygnałów).

Taki kontrakt ogranicza „puchnięcie” integracji. Jeśli kiedyś dojdzie nowe rozwiązanie chmurowe, podpina się ono do ustalonego interfejsu, zamiast od nowa dobierać się do PLC.

Krok 4: Kanał w górę (do chmury) i kanał w dół (do maszyny)

Architektura edge‑to‑cloud to nie tylko przekazywanie danych w górę. Prędzej czy później pojawia się potrzeba wysyłania w dół: nowych modeli, receptur, parametrów optymalizacyjnych. To wymaga świadomego rozdzielenia:

- kanału telemetrycznego – dane i zdarzenia „w górę”,

- kanału sterującego/konfiguracyjnego – polecenia, aktualizacje „w dół”.

W praktyce dobrze działa zasada, że wszystko, co „dotyka” maszyn, jest filtrowane i walidowane na poziomie edge. Chmura może zaproponować nową recepturę, ale dopiero edge sprawdza, czy jest kompletna, czy mieści się w dopuszczalnych zakresach i czy operator zatwierdził jej wysłanie do PLC.

Krok 5: Standaryzacja nazw, modeli danych i kontekstu

Jeśli każda linia nazywa „przestój” inaczej, a czasy cykli są liczone wg różnych zasad, nawet najpiękniejsza chmura pokaże chaos. Edge jest idealnym miejscem, żeby te różnice wygładzić. Można w nim:

- mapować lokalne nazwy tagów na wspólne standardy (np. „RUN_STATE” zamiast „M1_RUN”, „X001_RUN” itd.),

- ustalać jednolite słowniki dla zdarzeń (np. katalog kodów przestojów wspólny dla całego zakładu),

- normalizować jednostki i zakresy (np. zawsze °C, zawsze bary, te same progi alarmowe dla danej klasy urządzeń),

- doklejać kontekst technologiczny: numer gniazda, produkt, zlecenie, zmiana, partia surowca.

Dzięki temu chmura dostaje dane już „posprzątane”, a nie surowy zlepek tagów z różnych epok. W praktyce różnica jest ogromna: zamiast ręcznie składać raporty z pięciu systemów, analityk pracuje na jednym spójnym modelu, w którym „czas przezbrojenia” znaczy to samo niezależnie od linii.

Dobrze jest zacząć od małego, ale konsekwentnego zestawu standardów: kilka nazw stanów pracy, prosty model danych dla przestojów, jednolita konwencja nazewnicza dla tagów procesowych. Edge staje się wtedy miejscem, gdzie te ustalenia są egzekwowane. Jeśli nowa maszyna trafia na halę, integrator dopasowuje jej sygnały do istniejącego modelu, a nie wymyśla szóstą wersję „startu produkcji”.

W wielu zakładach przełom następuje dopiero wtedy, gdy pojawia się pierwszy „słownik zakładowy” i kilka prostych reguł w oprogramowaniu edge. Nagle okazuje się, że OEE z różnych wydziałów da się porównać, a dyskusja o „spadku wydajności” nie kończy się na sporze, kto jak liczy czasy mikroprzestojów. Jest wspólny język, są wspólne definicje i jest system, który to wymusza.

Tak poukładana architektura – od sterownika, przez rozsądnie zaprojektowany poziom edge, aż po chmurę – przestaje być zbiorem modnych haseł, a staje się narzędziem pracy. Operator widzi czytelne podpowiedzi, automatyk nie boi się każdej aktualizacji, IT wie, którędy płyną dane, a biznes może rzeczywiście oprzeć decyzje na liczbach. Granica między maszyną a chmurą wtedy mniej straszy, a bardziej przypomina dobrze oznakowaną drogę z wyraźnymi zjazdami i barierkami bezpieczeństwa.

Krok 6: Aktualizacje, wersjonowanie i „plan B”

Edge w zakładzie żyje. Dochodzą nowe reguły, integracje, wersje oprogramowania. Jeśli nie podejdzie się do tego świadomie, skończy się jak z „łataną” SCADĄ, której nikt już nie chce dotykać. Dlatego poziom edge potrzebuje zwykłej, inżynierskiej dyscypliny: wersji, kopii zapasowych i scenariusza na gorszy dzień.

Przydaje się kilka prostych zasad:

- widoczne wersje konfiguracji – nie tylko samego systemu edge, ale też przepływów danych, reguł, modeli; zmiana ma mieć numer, autora i datę,

- aktualizacje „najpierw na piaskownicy” – testowy węzeł edge w warsztacie, na którym można sprawdzić nową integrację z PLC, zanim trafi na linię z produkcją,

- możliwość szybkiego rollbacku – jeśli po wdrożeniu nowej wersji coś zaczyna się „dziwnie” zachowywać, powrót do poprzedniej konfiguracji ma być kwestią minut, a nie polowania na stare pliki.

Do tego dochodzi „plan B” na wypadek awarii węzła edge. W klasycznej automatyce pytanie brzmi: co się stanie, jeśli padnie ten komputer? Tutaj odpowiedź powinna być jasna i zapisana:

- czy maszyna dalej pracuje autonomicznie (PLC przejmuje sterowanie bez wsparcia edge),

- które funkcje znikają (np. raportowanie do MES, podpowiedzi dla operatora, wysyłka danych do chmury),

- jak odzyskać dane z bufora po przywróceniu systemu.

W praktyce dobrze działa schemat: PLC nigdy nie zależy od edge do podstawowego sterowania, a edge ma obowiązek buforować dane lokalnie przynajmniej przez kilka godzin lub dni. Po powrocie do życia wysyła „zaległości” do systemów nadrzędnych. Dla produkcji oznacza to, że nawet przy poważniejszej wpadce IT nikt nie zatrzymuje maszyny „bo padła chmura”.

Krok 7: Organizacja ludzi wokół nowej warstwy

Technologia to jedno, ale na końcu i tak wygrywa organizacja. Edge wprowadza dodatkową warstwę, której ktoś musi pilnować. Jeśli odpowiedzialność „rozmyje się” między automatyką, IT i utrzymaniem ruchu, granica między maszyną a chmurą znów zamieni się w szarą strefę.

Dobrze, gdy już na etapie projektu jest jasno ustalone:

- kto odpowiada za sprzęt edge (zasilanie, wymiany, fizyczne resetowanie),

- kto odpowiada za system i aplikacje (aktualizacje, konfiguracje, logi, bezpieczeństwo),

- kto ma prawo zmieniać reguły i modele na edge (np. dodawać nowe liczniki, zdarzenia, przeliczniki).

W wielu zakładach sprawdza się mały „zespół edge”: automatyk, ktoś z IT i czasem planer produkcji lub inżynier procesu. Spotykają się raz na jakiś czas, przeglądają logi, zgłaszane problemy, pomysły operatorów. Zmiany w konfiguracji przechodzą przez tę grupę, a nie są robione „po cichu” z czyjegoś laptopa na nocnej zmianie.

Brzmi biurokratycznie? W praktyce to raczej forma kontroli jakości. Tak jak nikt rozsądny nie zmienia logiki bezpieczeństwa w PLC bez przeglądu i testów, tak modyfikacje w przepływach edge powinny mieć prostą ścieżkę akceptacji. Dzięki temu za rok da się jeszcze odtworzyć, skąd wzięła się dana reguła i czemu licznik przestoju działa akurat tak, a nie inaczej.

Typowe błędy przy projektowaniu edge-to-cloud

Każdy zakład ma swoje historie „pierwszych podejść” do Przemysłu 4.0. W wielu z nich przewijają się podobne potknięcia związane z edge.

Pierwszy klasyk: próba wsadzenia wszystkiego do chmury na raz. Bez buforowania, bez filtracji. Efekt to przepełnione łącza, kłopoty z opóźnieniami i rachunki za transfer, które psują humor dyrektorowi finansowemu. Edge powinien być filtrem, nie przelotowym węzłem.

Drugi: „inteligentny edge”, który za bardzo wchodzi w buty PLC. Zbyt wiele funkcji sterowania realizowanych pośrednio, czasy reakcji zależne od stabilności zewnętrznych systemów, część logiki rozsiana po kilku warstwach. Gdy przychodzi awaria lub upgrade, nikt już nie wie, gdzie szukać przyczyny zachowania maszyny. Bezpieczniej trzymać zasadę: PLC steruje, edge wspiera i integruje.

Trzeci częsty błąd to brak czytelnych interfejsów. Każdy nowy projekt dorzuca własny kanał, protokół, format danych. Po kilku latach pojawia się swoisty „las kabli logicznych”: coś wysyła dane MQTT, coś się dobiera bezpośrednio po Modbusie, a jeszcze gdzie indziej ktoś dawno temu uruchomił eksport przez CSV na sieciowy dysk. Jedno dobrze zdefiniowane API na poziomie edge często rozwiązuje połowę tych kłopotów.

Bywa też odwrotnie: edge jako „magiczna skrzynka” bez przejrzystości. Dostawca stawia czarne pudełko, które „robi swoje”, ale nikt w zakładzie nie wie, co się w nim dzieje. Przez chwilę działa to nawet wygodnie, dopóki nie trzeba czegoś zmienić. Tam, gdzie granica między OT a IT ma być bezpieczna, przejrzystość działania jest równie ważna jak solidne szyfrowanie.

Jak zacząć małym krokiem, zamiast budować od razu „fabrykę w chmurze”

Jednym z rozsądniejszych podejść jest wybranie jednej linii lub gniazda jako poligonu doświadczalnego dla architektury edge-to-cloud. Zamiast rzucać się na cały zakład, lepiej dopracować proces na czymś, co da się „ogarnąć wzrokiem”.

Taki pierwszy krok często wygląda tak:

- stawiamy niewielki węzeł edge przy wybranej linii,

- podłączamy go do głównego sterownika lub kilku sterowników czynnych na tej linii,

- definiujemy kilka konkretnych mierników (np. OEE, podstawowe stany pracy, główne alarmy),

- ustalamy kanał do chmury wyłącznie dla danych telemetrycznych, bez sterowania „w dół”.

Po kilku tygodniach pracy widać, co działa, a co wymaga korekty: czy buforowanie jest wystarczające, czy nazwy tagów mają sens, czy operatorzy korzystają z podpowiedzi na HMI. Dopiero wtedy wiedza z tej jednej linii staje się szablonem dla kolejnych. To o wiele bezpieczniejsze niż próba zaprojektowania „docelowej architektury” przy biurku, bez sprawdzenia, jak zachowa się rzeczywista produkcja.

Bezpieczeństwo jako stały element, a nie „dodatek do projektu”

Edge, jeśli się sprawdzi, staje się węzłem krytycznym. Przez niego przechodzą dane z maszyn, przez niego często biegnie droga do chmury, przez niego można wysłać recepturę lub zaktualizować model. To naturalne miejsce, w którym kwestie bezpieczeństwa trzeba wbudować od pierwszego dnia, a nie dosztukowywać „kiedyś później”.

Na poziomie technicznym oznacza to kilka prostych, ale konsekwentnych praktyk:

- segmentację sieci – edge ma swoje VLAN-y i strefy, a dostęp do sterowników odbywa się przez jasno zdefiniowane reguły,

- kontrolę dostępu opartą na rolach – inny poziom uprawnień dla operatora, inny dla automatyka, inny dla dostawcy zewnętrznego,

- logowanie działań – kto i kiedy zmienił konfigurację, dodał regułę, uruchomił nowy kanał komunikacji,

- regularne łatki bezpieczeństwa – ale pod kontrolą, z procedurą testów na wspomnianym węźle „piaskownicy”.

Od strony organizacyjnej przydaje się wspólna rozmowa ludzi od OT i IT. Ci pierwsi często patrzą na świat z perspektywy ciągłości produkcji, ci drudzy z punktu widzenia integralności systemów i danych. Dobrze zaprojektowany edge to właśnie miejsce, gdzie te dwie perspektywy się spotykają. Jeśli jedna z nich zdominuje, granica między chmurą a maszyną szybko zrobi się albo niebezpiecznie otwarta, albo zupełnie nieużyteczna.

Edge jako platforma pod przyszłe pomysły

Na początku edge często robi proste rzeczy: zlicza, filtruje, wysyła. Po roku czy dwóch apetyt rośnie. Pojawia się chęć wdrożenia pierwszych modeli ML do predykcji awarii, integracji z systemami jakości, a może nawet łączenia danych procesowych z informacjami o energii i utrzymaniu ruchu. Jeśli warstwa edge została pomyślana jako platforma, a nie jednorazowy projekt, łatwiej na niej budować.

Co to znaczy w praktyce?

- otwarte, dobrze udokumentowane API,

- możliwość doinstalowania nowych modułów (np. kolejnych konektorów, procesorów strumieniowych, prostych modeli ML),

- spójny mechanizm zarządzania konfiguracją dla całej floty węzłów edge w zakładzie,

- miejsce na „piaskownicę” – środowisko, gdzie można bezpiecznie przyciąć dane, pouczyć model lub przetestować nową integrację bez dotykania produkcji.

Dobrym sygnałem jest moment, w którym inżynier procesu przychodzi z pomysłem typu: „Czy możemy na edge policzyć jeszcze taki wskaźnik?” i odpowiedź brzmi: „Tak, dopisujemy nowy przepływ, nie trzeba ruszać PLC ani robić osobnego projektu integracyjnego”. Wtedy widać, że granica między maszyną a chmurą przestaje być murem, a staje się elastycznym interfejsem, na którym da się sensownie eksperymentować.

Równowaga między „tu i teraz” a „wielką wizją”

Gdy pojawia się temat edge computingu, szybko wchodzą w grę wielkie obrazy: fabryka sterowana z chmury, cyfrowy bliźniak, zaawansowana analityka. Tymczasem na hali produkcyjnej najwięcej zmieniają na początku dość przyziemne rzeczy: lepsza widoczność przestojów, prostsze raporty, mniej kabli prowadzonych na skróty.

Gdy architektura od sterownika, przez edge, po chmurę jest układana rozsądnie, te dwie perspektywy da się pogodzić. Z jednej strony każdy kolejny krok daje namacalny efekt tu i teraz. Z drugiej – nie buduje się prowizorek, które zablokują rozwój za dwa lata. Tak właśnie rodzi się praktyczna odpowiedź na pytanie, gdzie kończy się chmura, a zaczyna maszyna: dokładnie tam, gdzie obie strony mogą robić to, co wychodzi im najlepiej, a poziom edge utrzymuje między nimi porządek.

Jak mierzyć sukces wdrożenia edge – praktyczne wskaźniki

Edge można zainstalować, skonfigurować i… dalej nie wiedzieć, czy to miało sens. Tak jak maszyna ma swoje cykle, wydajność i OEE, tak warstwa edge też powinna mieć własne mierniki. Bez tego po roku dyskusja sprowadza się do opinii: „działa” albo „ciągle coś nie gra”.

Najprościej zacząć od kilku prostych kategorii: technicznej, operacyjnej i biznesowej. Nie chodzi o rozbudowane raporty dla zarządu, tylko o garść wskaźników, które ktoś faktycznie będzie oglądał.

- Techniczne: dostępność węzłów edge, opóźnienia w przesyle danych do chmury, ilość zgubionych lub odrzuconych komunikatów, obciążenie CPU/pamięci w typowym dniu.

- Operacyjne: ile razy w miesiącu trzeba było interweniować „ręcznie” (restart, poprawa konfiguracji, zmiana reguł na żywo), ile czasu zajmuje wdrożenie prostej zmiany (np. nowy licznik stanu).

- Biznesowe: czas potrzebny na wygenerowanie kluczowych raportów (np. przestoje z wczoraj), szybkość reakcji na awarię w porównaniu do okresu sprzed edge, poprawa jakości danych raportowych (mniej korekt „na oko”).

Po kilku miesiącach dobrze widać, czy edge pomaga czy tylko produkuje nowe kłopoty. W jednym z zakładów metalowych prosta statystyka pokazała, że po wdrożeniu edge czas od wystąpienia dłuższego przestoju do reakcji brygadzisty skrócił się średnio o kilkanaście minut. Nikt wcześniej nie planował tego jako „KPI dla edge”, ale dane same zaczęły to pokazywać.

Jeśli architektura edge-to-cloud ma się rozwijać latami, takie liczby dają argumenty. Łatwiej wtedy uzasadnić kolejne inwestycje: nowe węzły, lepsze łącze, rozwinięcie analityki. Bez liczb pozostaje tylko wrażenie, że „idziemy w nowoczesność”.

Rola dostawców – jak uniknąć twardego „vendor lock-in” na granicy chmury i maszyny

Granica między maszyną a chmurą to miejsce, w którym spotyka się wielu dostawców: producent sterownika, integrator systemu MES, dostawca platformy chmurowej, firma od analityki. Każdy z nich ma swój „idealny” sposób połączenia z resztą świata. Bez lekkiej asertywności po stronie zakładu architektura szybko przypomina patchwork, a nie spójny system.

Najbardziej kłopotliwy jest scenariusz, w którym dostawca przychodzi z gotowym, zamkniętym pudełkiem edge. Wszystko działa, dopóki pracuje się tylko z jego produktami. Problem zaczyna się wtedy, gdy trzeba podłączyć coś spoza ekosystemu, przenieść system do innej chmury albo po prostu zmienić elementy architektury.

Dlatego dobrze, gdy to zakład definiuje kilka stałych zasad „granicznych”, a dostawcy muszą się do nich dostosować. Przykład? Obowiązek komunikacji z edge po standardowym protokole (OPC UA, MQTT) i zapis kluczowych danych w uzgodnionym, otwartym formacie. Dla jednego integratora może to być niewygodne, ale po 5–10 latach inwestycji widać różnicę między „otwartym” a „przyspawanym” rozwiązaniem.

Dobrym testem jest prośba do dostawcy: „Pokaż, jak wpiąć się w ten edge z zewnętrznej aplikacji, której nie ty jesteś autorem”. Jeśli odpowiedź sprowadza się do: „Nie da się” albo „Musimy napisać specjalny konektor”, lampka ostrzegawcza powinna się zapalić.

Jak rozmawiać z dostawcami o „granicy”

W rozmowach z dostawcami pomaga język, który łączy technikę z biznesem. Zamiast ogólnego „chcemy otwarte rozwiązania”, lepiej od razu mówić o konkretnych wymaganiach:

- jakie protokoły ma obsługiwać węzeł na granicy (z maszyn, do chmury, do innych systemów w zakładzie),

- w jakiej formie można eksportować dane (np. strukturę tagów z opisami, historię zdarzeń),

- czy i jak da się zmieniać konfigurację bez udziału dostawcy (nowe przepływy danych, nowe reguły filtracji),

- co się stanie, gdy zakład będzie chciał zastąpić jeden element łańcucha innym (np. przejść z chmury A na chmurę B).

Praktyczna zasada jest prosta: edge powinien być miejscem, gdzie da się wymienić „górę” (chmurę) albo „dół” (sterowniki, maszyny), nie rozbierając wszystkiego na części. Trochę jak z gniazdem zasilania – możesz zmienić urządzenie albo instalację wyżej, ale wtyczka i standard gniazda zostają takie same.

Edge w małych i średnich zakładach – czy to w ogóle ma sens?

Edge computing kojarzy się często z ogromnymi fabrykami, globalnymi koncernami i wielkimi budżetami. Tymczasem w praktyce małe i średnie zakłady mogą zyskać jeszcze więcej, właśnie dlatego, że wszystko da się u nich szybciej ogarnąć i poukładać.

Inna jest tylko skala. Zamiast dwudziestu węzłów edge rozmieszczonych po halach, pojawia się jeden, może dwa, obejmujące większy kawałek parku maszynowego. Logika jednak pozostaje ta sama: lokalne zbieranie danych, filtracja, buforowanie, podstawowa analityka i bezpieczne połączenie z zewnętrznym światem.

W niewielkim zakładzie produkcji opakowań, gdzie jest kilka linii i jedna niewielka sprężarkownia, węzeł edge potrafi:

- zbierać dane z kilku różnych sterowników (różne generacje, różnych producentów),

- liczyć proste wskaźniki OEE bez kupowania dużego systemu MES,

- pilnować progów alarmowych zużycia energii i wysyłać powiadomienia SMS lub mail,

- raz dziennie zsynchronizować dane z chmurą, gdzie ktoś z centrali robi spokojnie raporty.

Tu granica między maszyną a chmurą jest tym bardziej klarowna, że nikt nie ma czasu na dłubanie w skomplikowanych systemach. Edge staje się po prostu „mostkiem”, który ma działać, a nie tematem na godzinne debaty architektoniczne.

Od czego zacząć w mniejszej skali

Mały zakład nie potrzebuje od razu flotowego zarządzania dwudziestoma węzłami, ale kilka fundamentów i tak się przyda:

- jeden, centralny punkt zbierania danych (zamiast pięciu różnych aplikacji zainstalowanych po kątach),

- prosty, czytelny model danych – katalog maszyn, linie, podstawowe stany, kilka kluczowych liczników,

- jasne zasady dostępu: kto może logować się do edge, kto wprowadza zmiany, jak przechowuje się hasła,

- backup konfiguracji i mechanizm odtworzenia – choćby na zapasowym mini-PC w szafie automatyki.

W mniejszym zakładzie często jedna osoba „robi za wszystko”: automatyk, informatyk, czasem jeszcze energetyk. Edge ma pomóc tej osobie skupić się na istotnych problemach, nie na ręcznym przeklejaniu danych do Excela. Jeżeli po miesiącu od wdrożenia nadal trzeba codziennie coś „dopychać kolanem”, to znak, że granica między chmurą a maszyną została zaprojektowana zbyt skomplikowanie jak na daną skalę.

Edge a systemy MES/SCADA – kto za co odpowiada

W wielu fabrykach systemy MES i SCADA funkcjonują od lat. Pojawienie się edge rodzi naturalne pytanie: czy to ich następca, czy kolejna warstwa pośrodku? Odpowiedź najczęściej brzmi: „to inny kawałek układanki”.

SCADA skupia się na nadzorze i wizualizacji – podgląd bieżących parametrów, alarmy, sterowanie. MES łączy produkcję z planowaniem: zlecenia, rozliczanie pracy, śledzenie partii. Edge natomiast pełni rolę tłumacza i strażnika ruchu danych między maszynami a resztą świata.

Praktyczne rozgraniczenie wygląda często tak:

- SCADA – wizualizacja w czasie rzeczywistym, działania operatora, ekran na hali,

- MES – zlecenia produkcyjne, raporty wydajności, integracja z ERP,

- Edge – akwizycja i obróbka danych, standaryzacja tagów, filtracja, buforowanie, wysyłanie danych do chmury i systemów powyżej.

Można to porównać do sytuacji na lotnisku: SCADA to wieża kontroli lotów, MES to system zarządzania siatką połączeń, a edge pełni rolę wyspecjalizowanej „poczty lotniczej” – bierze dane z różnych maszyn, pakuje do ujednoliconej formy i wysyła tam, gdzie trzeba. Wieża nie zajmuje się pakowaniem listów, a poczta nie wydaje zgody na start samolotu.

Kiedy opłaca się wprowadzić edge „między” SCADA a chmurę

Są zakłady, które przez lata wysyłały dane z SCADA bezpośrednio do chmury. Działało, dopóki liczba maszyn i zakres integracji był niewielki. Gdy pojawił się drugi system MES, osobna analityka jakościowa i aplikacje maintenance, wszystko zaczęło się plątać.

W takich sytuacjach edge porządkuje krajobraz:

- zdejmuje z SCADA rolę „wszystkomogącego integratora”,

- zapewnia jeden, stabilny punkt wyjścia danych do różnych „odbiorców” w IT i chmurze,

- pozwala rozwijać funkcje analityczne bez wchodzenia w delikatną konfigurację istniejącej SCADY.

W praktyce bywa, że po wprowadzeniu edge rola SCADA bardziej wraca do korzeni – porządna wizualizacja, szybka reakcja na alarmy, wygoda pracy dla operatorów. A „ekwilibrystyka integracyjna” przenosi się właśnie na warstwę edge, która jest do tego lepiej przygotowana.

Edge w środowiskach regulowanych i z wysokimi wymaganiami jakościowymi

W branżach takich jak farmacja, spożywka czy automotive granica między maszyną a chmurą jest nie tylko kwestią techniczną, ale także regulacyjną. Dochodzą wymagania audytów, norm jakości, często również walidacji systemów. Każda zmiana ma swoją dokumentację, a hasło „chmura” nadal potrafi wywołać lawinę pytań z działu jakości.

Edge może tu odegrać ciekawą rolę: zostać „regulowaną granicą”, która jest pod pełną kontrolą zakładu, a jednocześnie otwiera drogę do korzystania z usług chmurowych bez naruszania twardych zasad.

W praktyce wygląda to tak, że:

- pełne, szczegółowe dane procesowe zostają na edge i w systemach on-premise,

- do chmury trafiają zredukowane, zagregowane informacje – np. wskaźniki, trendy, wyniki analiz,

- na edge pilnowana jest spójność czasu, wersjonowanie receptur, a także log zmian, który da się pokazać audytorowi.

Dzięki temu można mieć z jednej strony zgodność z wymaganiami (bo „źródło prawdy” jest w środowisku całkowicie kontrolowanym), z drugiej – korzystać z mocy obliczeniowej i narzędzi chmurowych tam, gdzie nie wchodzi się w konflikt z regulacjami.

Logika jakościowa i ścieżka audytu na edge

W środowiskach regulowanych jednym z kluczowych zagadnień jest śledzenie, kto co zrobił i kiedy. Dobrze zaprojektowany edge staje się naturalnym miejscem, gdzie:

- rejestrowane są wszystkie zmiany konfiguracji – z podpisem użytkownika, czasem i opisem,

- przechowywana jest historia wersji przepływów i reguł, które wpływają na przetwarzanie danych,

- powstaje indeks powiązań między partiami produkcyjnymi, maszynami, recepturami i zdarzeniami procesowymi.

Audytor nie musi wtedy oglądać całej chmury ani zaglądać do każdego sterownika. Wystarczy, że na poziomie edge zobaczy, jak były zbierane, przetwarzane i zabezpieczane dane, które potem w formie zagregowanej trafiły wyżej. To trochę jak z księgowością – nie trzeba każdemu pokazywać pełnego wglądu w system finansowy, ale trzeba umieć udowodnić, co i skąd przeszło do sprawozdań.

Przyszłość granicy: od „pudełka edge” do rozproszonej warstwy

Dziś edge najczęściej kojarzy się z fizycznym urządzeniem: przemysłowym PC, gatewayem, serwerem w szafie automatyki. Coraz częściej jednak sama idea edge rozlewa się po kilku warstwach: trochę logiki w sterowniku, trochę na lokalnym serwerze, trochę w mikroserwisach działających bliżej maszyn niż chmury.

Pojawiają się urządzenia typu „smart sensor” z własną mocą obliczeniową i komunikacją bezpośrednio do chmury. Maszyny wychodzą z fabryki producenta z wbudowanym minikomputerem edge, który potrafi sam zbierać i przetwarzać dane. Do tego dochodzą kontenery uruchamiane na małych klastrach w hali, które biorą na siebie cięższe zadania analityczne.

Granica między chmurą a maszyną staje się więc mniej linią, a bardziej pasem przygranicznym. Nadal jednak potrzebna jest spójna koncepcja: gdzie jest „centrum dowodzenia”, gdzie definiuje się standardy danych, gdzie włącza się i wyłącza konkretne funkcje. Nawet jeśli fizycznie edge rozproszy się po kilku miejscach, ktoś musi nad tym panować.

Coraz większą rolę będzie tu odgrywać oprogramowanie zarządzające całym „stadem” urządzeń edge. Zamiast logowania się po kolei na każdy gateway, konfigurację, aktualizacje i dystrybucję aplikacji przejmuje centralny system – często ten sam, który zarządza aplikacjami chmurowymi. Z punktu widzenia automatyka ważne jest, żeby mimo tej złożoności dało się zadać kilka prostych zasad: co wolno instalować, kto zatwierdza zmiany, jak szybko można wycofać błędną wersję.

W praktyce scenariusz może wyglądać tak: nowy algorytm detekcji anomalii powstaje w chmurze, jest „oswojony” na historycznych danych, a potem w kontrolowany sposób ląduje na wybranych urządzeniach edge w hali. Działa najpierw na kilku maszynach pilotażowych, później – po akceptacji – jest stopniowo rozszerzany. Z zewnątrz wygląda to jak zwykła aktualizacja aplikacji; wewnątrz fabryki to jednak precyzyjna operacja na granicy między IT a OT.

Drugim kierunkiem rozwoju jest coraz większa „inteligencja” samych urządzeń na dole. Sterowniki, które dziś obsługują głównie logikę drabinkową, dostają możliwość uruchamiania skryptów czy lekkich kontenerów. Czujniki zaczynają lokalnie liczyć wskaźniki, odfiltrowywać szum i wysyłać dalej tylko to, co naprawdę ma znaczenie. W efekcie część funkcji, które jeszcze niedawno były „typowo edge’owe”, przesuwa się bliżej maszyny, a rola edge staje się bardziej koordynacyjna niż obliczeniowa.

Żeby w takim świecie zachować porządek, przydaje się coś w rodzaju „konstytucji danych” w zakładzie: prosty opis, jakie typy informacji istnieją, kto jest ich właścicielem, jak długo i gdzie są przechowywane. Wtedy nawet jeśli fizycznie edge jest rozproszony, wiadomo, według jakich zasad ma działać. Bez tego łatwo skończyć z sytuacją, w której każdy dostawca maszyny dorzuca swoje „mini-edge” i po kilku latach nikt już nie panuje nad całością.

Kluczowe staje się więc nie to, czy edge stoi w jednym pudełku, czy w pięciu miejscach, ale czy potrafi panować nad przepływem informacji między maszyną a chmurą. Jeśli operator rozumie, skąd biorą się dane na ekranie, automatyk wie, gdzie szukać przyczyny błędu, a dział IT ma jasną ścieżkę integracji z resztą systemów – granica została zaprojektowana rozsądnie, niezależnie od tego, jak bardzo „przygraniczny pas” rozrósł się technologicznie.

Najważniejsze punkty

- Sterownik PLC pozostaje miejscem na wszystko, co decyduje o bezpieczeństwie i ciągłości procesu – reakcje muszą być lokalne, deterministyczne i liczone w milisekundach, bez zależności od chmury czy niestabilnej sieci.

- Edge computing nie zastępuje PLC, tylko go rozszerza: zbiera dane z wielu źródeł, normalizuje protokoły, wykonuje wstępną analitykę i podejmuje lokalne decyzje wspomagające produkcję, ale niekrytyczne dla bezpieczeństwa.

- Chmura pełni rolę „globalnego mózgu” – służy do analityki, archiwizacji, uczenia maszynowego i integracji biznesowej, natomiast nie powinna bezpośrednio sterować maszyną ze względu na opóźnienia, brak deterministyczności i ryzyko utraty łączności.

- Praktyczne podejście do podziału zadań jest takie: chmura ustala strategię (np. optymalne nastawy z analizy tygodniowych danych), a warstwa edge i PLC odpowiada za taktykę, czyli bezpieczne, szybkie wdrożenie zmian na poziomie maszyn.

- Im większa wrażliwość funkcji na czas reakcji i im bliżej jest ona bezpieczeństwa (PID, interlocki, E‑stop, lokalne HMI), tym niżej w architekturze powinna się znaleźć; funkcje analityczne, raportowe czy planistyczne można spokojnie wynieść do edge lub chmury.

- Granica przebiega też organizacyjnie: warstwy sterowania i edge są zwykle domeną OT/UT, a chmura – IT; zbyt szybkie „wypychanie” wszystkiego do chmury odbiera automatykom kontrolę nad danymi i utrudnia diagnozowanie problemów przy awariach sieci.

Bardzo interesujący artykuł! Edge computing w automatyce to naprawdę fascynujące zagadnienie, które sprawia, że granica między chmurą a maszyną staje się coraz bardziej rozmyta. Cieszę się, że autor poruszył ten temat i zwrócił uwagę na to, jak ważne jest zrozumienie różnic między obiema technologiami. Mam nadzieję, że w przyszłości będziemy mogli obserwować jeszcze więcej innowacyjnych rozwiązań opartych na edge computing w przemyśle. Oby więcej artykułów poruszało tak ciekawe tematy!

Możliwość dodawania komentarzy nie jest dostępna.